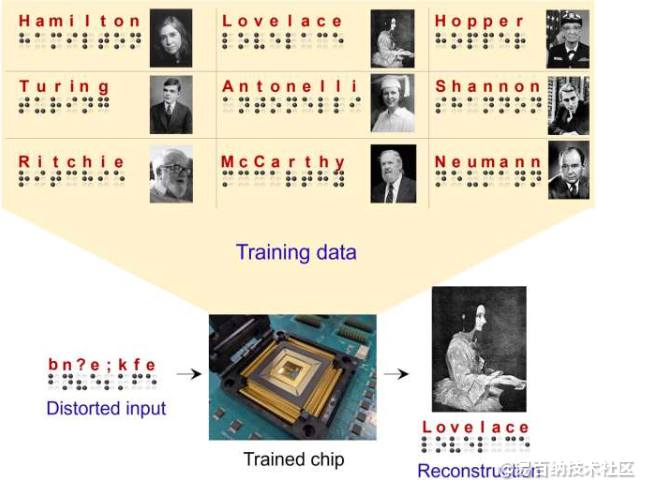

由忆阻器横杆组成的芯片使用本地片上学习算法进行训练。该团队证明,他们的方法可以从高度失真的输入中准确地重建九位著名计算机科学家的盲文表示。

由忆阻器横杆组成的芯片使用本地片上学习算法进行训练。该团队证明,他们的方法可以从高度失真的输入中准确地重建九位著名计算机科学家的盲文表示。

深度学习模型已被证明是非常有价值的工具,用于进行预测和解决涉及数据分析的实际任务。尽管它们具有优势,但在部署到实际软件和手机等设备之前,这些模型需要在物理数据中心进行大量培训,这可能既耗时又耗能。

德克萨斯A&M大学,Rain Neuromorphics和桑迪亚国家实验室的研究人员最近设计了一个新系统,用于更高效,更大规模地训练深度学习模型。该系统在Nature Electronics上发表的一篇论文中介绍,依赖于使用新的训练算法和忆阻器横杆硬件,可以一次执行多个操作。

“大多数人将人工智能与智能手表中的健康监测、智能手机中的人脸识别等联系起来,但就消耗的能量而言,大多数人工智能都需要训练人工智能模型来执行这些任务,”该研究的资深作者Suhas Kumar告诉TechXplore。

“培训在仓库大小的数据中心进行,这在经济上和碳足迹方面都非常昂贵。只有经过全面训练的模型才能下载到我们的低功耗设备上。”

从本质上讲,Kumar和他的同事们开始设计一种方法,可以减少与人工智能模型训练相关的碳足迹和财务成本,从而使其大规模实施更容易,更可持续。为了做到这一点,他们必须克服当前人工智能训练实践的两个关键限制。

第一个挑战与使用基于图形处理单元(gpu)的低效率硬件系统有关,这些硬件系统本质上并不是为运行和训练深度学习模型而设计的。第二种需要使用无效的和数学繁重的软件工具,特别是利用所谓的反向传播算法。

“我们的目标是使用新的硬件和新的算法,”库马尔解释说。“我们利用了过去15年在基于忆阻器的硬件(gpu的高度并行替代品)方面的工作,以及最近在类脑高效算法(非反向传播局部学习技术)方面的进展。虽然硬件和软件之前已经有了进步,但我们共同设计了它们,使它们能够相互协作,从而实现非常节能的人工智能训练。”

深度神经网络的训练需要不断调整其配置,包括所谓的“权重”,以确保它能够越来越准确地识别数据中的模式。这种适应过程需要大量的乘法运算,而传统的数字处理器很难有效地执行,因为它们需要从单独的存储单元中获取与重量相关的信息。

该研究的主要作者Suin Yi告诉TechXplore:“如今几乎所有的训练都是使用反向传播算法进行的,该算法采用了大量的数据移动和求解数学方程,因此适用于数字处理器。”

“作为一种硬件解决方案,模拟忆阻器交叉条在过去十年中出现,可以将突触权重嵌入到计算发生的同一位置,从而最大限度地减少数据移动。然而,传统的反向传播算法适用于高精度数字硬件,由于其硬件噪声、误差和精度有限,与忆阻器交叉棒不兼容。”

由于传统的反向传播算法不太适合他们设想的系统,Kumar, Yi和他们的同事开发了一种新的协同优化学习算法,利用忆阻器交叉条的硬件并行性。这种算法的灵感来自于神经科学研究中观察到的神经元活动的差异,它能容忍错误,并复制大脑从稀疏、定义不清和“嘈杂”的信息中学习的能力。

“我们的算法-硬件系统研究了神经网络中合成神经元在两种不同条件下的不同表现:一种是允许以自由方式产生任何输出,另一种是我们强制输出为我们想要识别的目标模式,”Yi解释道。

“通过研究系统响应之间的差异,我们可以预测使系统得到正确答案所需的权重,而不必强迫它。换句话说,我们避免了复杂的数学方程反向传播,使过程更具抗噪性,并实现局部训练,这就是大脑学习新任务的方式。”

作为这项研究的一部分,开发的受大脑启发和模拟硬件兼容的算法最终可以在具有小型电池的边缘设备中实现AI的节能实现,从而消除对消耗大量电能的大型云服务器的需求。这最终可能有助于使深度学习算法的大规模训练更经济、更可持续。

该论文的另一位作者杰克·肯德尔(Jack Kendall)告诉TechXplore:“我们用来训练神经网络的算法结合了深度学习和神经科学的一些最好的方面,创建了一个可以非常有效地使用低精度设备学习的系统。”

“这有很多含义。首先,使用我们的方法,目前太大而无法部署的AI模型可以被制作成适合手机、智能手表和其他无绳设备的模型。另一个原因是,这些网络现在可以在部署时进行实时学习,例如考虑环境变化,或将用户数据保存在本地(避免将其发送到云端进行训练)。”

在最初的评估中,Kumar、Yi、Kendall和他们的同事Stanley Williams表明,与当今市场上最好的gpu相比,他们的方法可以将与AI训练相关的功耗降低多达10万倍。在未来,它可以实现大规模数据中心转移到用户的个人设备上,减少与AI训练相关的碳足迹,并促进更多人工神经网络的发展,支持或简化人类的日常活动。

“我们下一步计划研究这些系统如何扩展到更大的网络和更困难的任务,”肯德尔补充道。“我们还计划研究各种大脑启发的学习算法,用于训练深度神经网络,并找出哪些算法在不同的网络和不同的硬件资源约束下表现更好。我们相信,这不仅能帮助我们理解如何在资源有限的环境中最好地进行学习,还能帮助我们理解生物大脑如何能够以如此惊人的效率学习。”

免责声明:文章内容来自互联网,本站不对其真实性负责,也不承担任何法律责任,如有侵权等情况,请与本站联系删除。

转载请注明出处:基于忆阻交叉的可扩展和节能AI学习系统-什么是忆阻器 https://www.yhzz.com.cn/a/9472.html