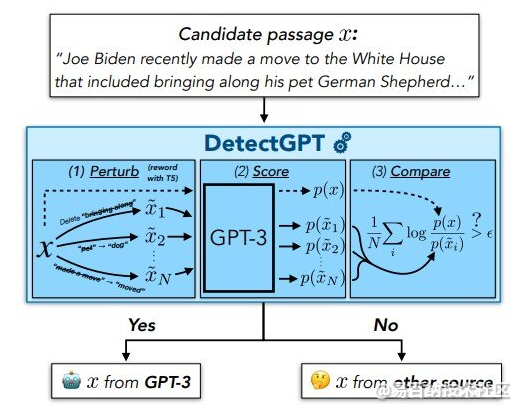

我们旨在确定一段文本是否由特定的LLM p生成,例如GPT-3。为了对候选传代 x 进行分类,DetectGPT 首先使用通用预训练模型(如 T5)生成传代 x ̃i 的轻微扰动。然后 DetectGPT 将原始样本 x 的 p 下的对数概率与每个扰动样本 x ̃i 进行比较。如果平均对数比率较高,则样本可能来自源模型

OpenAI的ChatGPT的推出,其对问题或提示的非常连贯的回应,将大型语言模型(LLM)及其功能推向了公众意识。头条新闻既令人兴奋又令人担忧:它能写求职信吗?允许人们用新语言交流?帮助学生在考试中作弊?通过社交媒体影响选民?让作家失业?

现在,随着谷歌、Meta等类似模型的出现,研究人员呼吁加强监管。

“我们需要新的基础设施和工具来为这些模型提供护栏,”斯坦福大学四年级计算机科学研究生埃里克·安东尼·米切尔(Eric Anthony Mitchell)说,他的博士研究重点是开发这样的基础设施。

一个关键的护栏将为教师、记者和公民提供一种方法,让他们知道何时他们正在阅读由LLM而不是人类生成的文本。为此,Mitchell和他的同事开发了DetectGPT,并在上周发布了一个演示和一篇论文,用于区分人类生成的文本和llm生成的文本。在最初的实验中,该工具在五个流行的开源llm中准确地识别了95%的作者身份。

虽然该工具还处于早期阶段,但米切尔希望将其改进到可以造福社会的程度。

“这些语言模型的研究和部署进展迅速,”斯坦福大学计算机科学和电气工程助理教授、米切尔的顾问之一切尔西·芬恩(Chelsea Finn)说。“公众需要更多的工具来了解我们何时阅读模型生成的文本。”

一种直觉

就在两个月前,同为研究生、合著者的亚历山大·哈茨基(Alexander Khazatsky)给米切尔发短信问:你认为有办法区分一篇文章是否由ChatGPT写的吗?这引起了米切尔的思考。

研究人员已经尝试了几种混合效果的通用方法。OpenAI自己使用的一种方法是用人类和LLM生成的文本训练一个模型,然后要求它分类另一个文本是由人类还是LLM编写的。但是,米切尔认为,要在多个学科领域和语言中取得成功,这种方法需要大量的数据进行训练。

第二种现有的方法避免了训练新模型,只是简单地使用可能生成文本的LLM来检测它自己的输出。米切尔说,本质上,这种方法要求LLM有多“喜欢”一个文本样本。他说的“喜欢”并不是指这是一个有偏好的感知模型。更确切地说,模型对一段文本的“喜欢”是表示“得分高”的一种速记方式,它涉及一个单一的数字:根据模型,特定单词序列同时出现的概率。“如果它很喜欢它,那可能是模型造成的。如果没有,那就不是来自模型。”米切尔说,这种方法相当有效。“它比随机猜测要好得多。”

但当米切尔思考卡扎茨基的问题时,他有了最初的直觉,因为即使是强大的LLM在使用一种说法而不是另一种说法时,也会有微妙的、任意的偏见,LLM倾向于“喜欢”自己输出的任何轻微的重新措辞,而不是原始的。相比之下,即使LLM“喜欢”了一段人工生成的文本,这意味着它给了它一个高概率评级,模型对该文本稍加修改的版本的评估也会更加多样化。“如果我们干扰了一个人工生成的文本,模型对它的喜爱程度大致相同。”

米切尔还意识到,他的直觉可以通过流行的开源模型进行测试,包括OpenAI的API。米切尔说:“计算一个模型对特定文本的喜爱程度基本上就是这些模型的训练方式。”“他们会自动给我们这个数字,结果证明这真的很有用。”

测试直觉

为了验证米切尔的想法,他和他的同事们进行了实验,评估了各种公开的llm对人工生成文本以及他们自己的llm生成文本的喜爱程度,包括假新闻文章、创造性写作和学术论文。他们还评估了LLMs对每个LLM和人工生成文本的100个扰动的平均喜爱程度。当研究小组绘制LLM的这两个数字之间的差异时,与人工生成的文本相比,他们看到了两条几乎没有重叠的钟形曲线。米切尔说:“我们可以用这个数字很好地区分文本的来源。”“与仅仅衡量模型对原始文本的喜爱程度的方法相比,我们得到了更可靠的结果。”

在团队最初的实验中,DetectGPT在使用GPT3-NeoX (OpenAI GPT模型的一个强大的开源变体)时,成功地对人类和llm生成的文本进行了95%的分类。DetectGPT还能够使用llm(而不是原始源模型)检测人类与llm生成的文本,但可信度略低。(到目前为止,ChatGPT还不能公开用于直接测试。)

对检测更感兴趣

其他组织也在寻找识别人工智能书写文本的方法。事实上,OpenAI上周发布了新的文本分类器,并报告说,它正确识别人工智能书写的文本的准确率为26%,错误地将人类书写的文本分类为人工智能书写的准确率为9%。

Mitchell不愿意直接将OpenAI的结果与DetectGPT的结果进行比较,因为没有标准化的数据集进行评估。但他的团队确实使用OpenAI上一代预训练的人工智能检测器进行了一些实验,发现它在英语新闻文章上表现良好,在PubMed文章上表现不佳,在德语新闻文章上完全失败。他说,对于依赖于预训练的模型来说,这种混合结果很常见。相比之下,DetectGPT对于这三个领域都是开箱即用的。

不易被发现

Mitchell说,尽管DetectGPT演示只公开了大约一个星期,但反馈已经有助于识别一些漏洞。例如,一个人可以有策略地设计一个ChatGPT提示来逃避检测,例如要求LLM以特殊的方式说话或以看起来更人性化的方式说话。该团队对于如何减轻这个问题有一些想法,但还没有对它们进行测试。

另一个担忧是,使用ChatGPT等LLMs在作业中作弊的学生,会简单地编辑人工智能生成的文本,以逃避检测。米切尔和他的团队在他们的工作中探索了这种可能性,发现尽管对编辑文章的检测质量有所下降,但当修改的单词少于10%-15%时,系统仍然能很好地识别出机器生成的文本。

米切尔说,从长远来看,我们的目标是为公众提供可靠的、可操作的预测,以确定一篇文本——甚至是文本的一部分——是否是机器生成的。他说:“即使一个模型不认为整篇文章或新闻文章是由机器写的,你也会想要一个工具,可以突出一个看起来特别机器制作的段落或句子。”

需要明确的是,Mitchell认为llm在教育、新闻和其他领域有很多合法的用例。然而,他说:“为教师、新闻播音员和整个社会提供验证他们所消费的信息来源的工具一直都很有用,即使在人工智能时代也是如此。”

为LLMs建造护栏

DetectGPT只是Mitchell为LLMs构建的几个护栏之一。在过去的一年里,他还发布了几种编辑LLM的方法,以及一种称为“自毁模型”的策略,当有人试图将LLM用于邪恶的目的时,该策略会禁用LLM。

在完成博士学位之前,米切尔希望至少再一次完善这些策略。但现在,米切尔很感激他在12月的直觉。“在科学领域,你的第一个想法很少能像DetectGPT一样奏效。我很高兴地承认,我们有点幸运。”

免责声明:文章内容来自互联网,本站不对其真实性负责,也不承担任何法律责任,如有侵权等情况,请与本站联系删除。

转载请注明出处:人类作家还是人工智能?学者们构建检测工具-人工智能与文学文献综述 https://www.yhzz.com.cn/a/9190.html