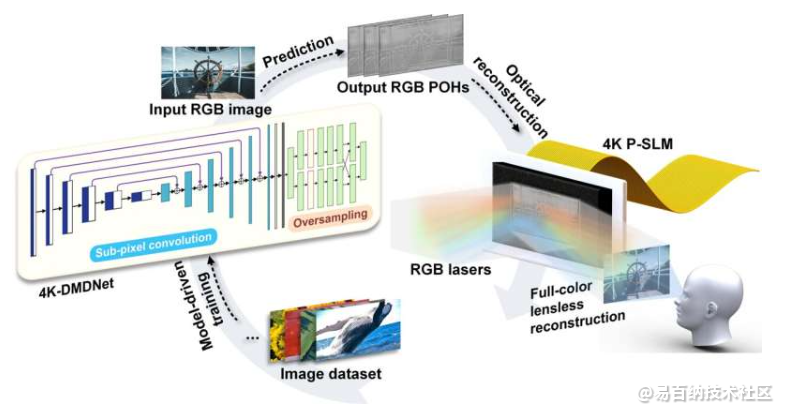

4K-DMDNet的4K全息图生成和重建过程

2009年,IMAX3D电影《阿凡达》席卷全球电影市场。几年后,初音未来3D演唱会吸引了所有动漫迷的目光。最近,AR/VR 3D 头饰设备导致了元宇宙的蓬勃 发展。3D显示领域的每一次进步都带来了重要的社会关注和经济效益。

为了获得更逼真的视觉体验,大多数主流的3D显示商业解决方案都是基于双目视觉的原理。

然而,与观察真实3D物体不同,当观看者佩戴设备获取3D信息时,视觉焦点的深度保持不变。这种会聚调节冲突使观众容易出现视觉疲劳和眩晕,从而限制了用户体验。

计算机生成全息术(CGH)可以从源头上避免会聚调节冲突的产生。实验设置简单紧凑。CGH受到了学术界和工业界的极大关注。它被认为是3D显示的未来形式。

原则上,CGH根据衍射计算将3D对象编码为数字二维(2D)全息图。然后将2D全息图上传到由平面波照亮的空间光调制器(SLM)。在一定距离处获得3D物体的光学重建。CGH在头戴式显示器、平视显示器和投影显示器等广泛的3D显示器中具有潜在的应用前景。

如何生成高速、高质量的二维全息图是目前该领域的一个关键问题和重要的研究方向。

最近,清华大学的Hololab提出了一种模型驱动的深度学习神经网络,称为4K-DMDNet。实现高品质高速全息图生成,实现高保真4K彩色全息显示。该论文发表在《光电进展》杂志上。

a)数据驱动的深度学习与(b)4K-DMDNet在训练原理方面的比较

由于SLM的局限性,需要将全息平面上计算出的复振幅分布转换为仅振幅全息图或仅相位全息图(POH)。其中,POH生成过程通常是一个不合适的逆问题。它面临的挑战是解决方案可能不是唯一的、稳定的或现有的。

迭代算法可以将POH生成过程转换为优化问题。可以得到收敛性好的数值解。然而,这些算法面临着计算速度和重建质量之间的权衡。

深度学习强大的并行处理能力在解决优化问题方面带来了革命性的改进。深度学习对CGH的深远影响也已经显现出来。

预先获取3D对象的训练数据集和相应的全息图数据集,作为神经网络的输入和输出。神经网络经过训练以学习它们之间的映射关系。经过训练的网络可以实现对训练数据集外显示目标输入的快速预测。有望同时实现高速、高质量的全息图生成。

日本研究人员早在1998年就提出了使用神经网络生成全息图的想法。但受限于当时计算机的软硬件性能,只获得了初步结果。

随着GPU和卷积神经网络(CNN)的广泛应用,当前的硬件和软件性能更适合CGH的数学特性。基于学习的CGH得到了快速发展。

2021 年,麻省理工学院的研究人员提出了一种张量全息网络,可以在智能手机上实时生成 2K 全息图。

为了获得准确的网络预测,训练数据集和相应的全息影像数据集需要一个耗时的生成过程。此外,由于网络只是学习输入和输出之间的映射,因此全息影像数据集的质量限制了训练结果的上限。

为了突破数据驱动深度学习的上述局限性,该文提出一种基于模型驱动深度学习的全息图生成方案。

不是提前生成全息影像数据集,而是使用逆问题的正向物理模型作为模型驱动方法中的约束来训练网络。因此,网络可以学习如何自主编码全息影像,突破全息影像数据集大小和质量的限制。

然而,传统的模型驱动的深度学习网络需要在显示目标上进行迁移学习,以实现更好的性能。额外的时间成本限制了模型驱动深度学习的实际应用。

这项工作中提出的4K-DMDNet使用残余U-Net神经网络框架。菲涅耳衍射模型充当训练过程的约束。它能够在没有迁移学习的情况下生成高保真 4K 全息图。

一般来说,网络的预测性能既受网络学习能力有限的影响,也受训练过程中约束不足的影响。

为了解决学习能力有限的挑战,4K-DMDNet引入了亚像素卷积方法。在上采样路径中,利用卷积将通道数扩展四倍,通过像素洗牌获得空间扩展。亚像素卷积方法解决了传统转置卷积中为空间展开添加大量零参数的挑战。它将上采样路径中的可学习参数增加到原始大小的四倍,而不会改变整体数据量。它有效地增强了网络的学习能力,从而显著提高了重建的清晰度和保真度。

为了解决训练过程中约束不足的挑战,4K-DMDNet在菲涅耳衍射模型中引入了过采样操作。频域中的约束区域为零填充,以使计算过程中的大小加倍。根据空间采样区间与频率范围的映射,重建符合奈奎斯特-香农采样定理。在收紧频域约束的同时,衍射模型的精度得到提高。

免责声明:文章内容来自互联网,本站不对其真实性负责,也不承担任何法律责任,如有侵权等情况,请与本站联系删除。

转载请注明出处:使用模型驱动的深度学习实现高保真 4K 彩色全息显示-模型驱动数据驱动 https://www.yhzz.com.cn/a/9134.html