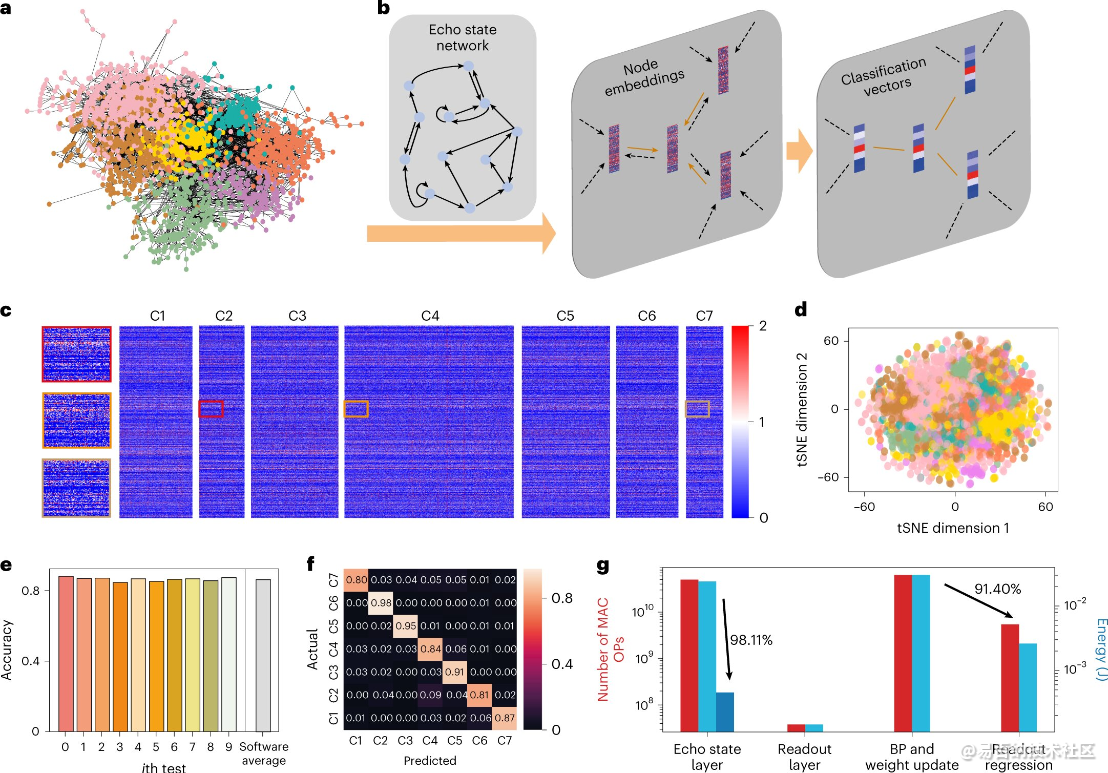

a、 大型引文网络CORA的图解

b、 节点分类方案

c、 模拟节点嵌入的图示

d、 使用t-SNE将节点嵌入映射到2D间距,显示出相同类别的节点的清晰聚类

e、 节点分类和软件基线的十个随机测试的准确性。平均准确率为87.12%,与最先进的算法相当

f、 模拟分类结果的归一化混淆矩阵

g、 估计的OPs(红色条)和相关的能量消耗(浅蓝色条代表最先进的GPU;深蓝色条形图为投影随机电阻式基于内存的混合模拟-数字系统)。在前向(后向)传递中,最先进的GPU上的完全可训练模型和基于投影随机电阻存储器的混合模拟-数字系统上的ESGNN分别消耗约24.20 mJ(约63.18 GOPs)和约599.47 μJ(约5.43 GOPs),推理能量效率提高了40.37倍(后向传递复杂度降低了约91.40%)。

图神经网络(GNNs)是一种很有前途的机器学习架构,用于分析可以用图表示的数据。这些架构在各种现实应用中取得了非常有前景的结果,包括药物发现、社交网络设计和推荐系统。

由于图结构数据可能非常复杂,因此应该仔细而有效地设计基于图的机器学习架构。此外,理想情况下,这些体系结构应该运行在高效的硬件上,这些硬件支持它们的计算需求,而不会消耗太多的能量。

香港大学、中国科学院、InnoHK中心和世界各地其他研究所的研究人员最近开发了一种软硬件系统,该系统将GNN架构与电阻存储器结合在一起,这是一种以电阻态形式存储数据的存储解决方案。

开展这项研究的研究人员之一Shaocong Wang表示:“数字计算机的效率受到冯·诺依曼瓶颈和摩尔定律放缓的限制。前者是由于内存和处理单元物理分离的结果,在运行图学习时,由于这些单元之间频繁而大量的数据穿梭,导致了大量的能量和时间消耗。后者是因为晶体管缩放在3nm技术节点时代正接近其物理极限。”

电阻存储器本质上是可调电阻器,是一种阻止电流通过的器件。这些基于电阻器的存储器解决方案已被证明对运行人工神经网络(Ann)非常有前景。这是因为单个电阻存储单元既可以存储数据又可以执行计算,从而解决了所谓的Naumann瓶颈的局限性。

“电阻存储器也是高度可扩展的,保留了摩尔定律,”Wang说。“但普通的电阻存储器仍然不足以进行图形学习,因为图形学习经常改变电阻存储器的电阻,与使用SRAM和DRAM的传统数字计算机相比,这会导致大量的能量消耗。此外,电阻变化不准确,阻碍了精确的梯度更新和权重写入。这些缺点可能会抵消电阻存储器在高效图形学习方面的优势。”

Wang和他的同事最近工作的主要目标是克服传统电阻存储器解决方案的局限性。

他们特别使用了回声状态网络,这是一种基于循环神经网络的储层计算架构,具有稀疏连接的隐藏层。这些网络的大多数参数(即权重)可以是固定的随机值。这意味着它们可以使电阻存储器立即适用,而不需要编程。

“在我们的研究中,我们通过实验验证了图形学习的这一概念,这是非常重要的,事实上,相当普遍,”王说。“实际上,图像和序列数据,如音频和文本,也可以表示为图形。即使是最先进和最主要的深度学习模型变形金刚,也可以表示为图神经网络。”

Wang和他的同事开发的回波状态图神经网络由两个不同的组件组成,称为回波状态层和读出层。回声状态层的权重是固定和随机的,因此需要随着时间的推移反复训练或更新。

Wang说:“回声状态层作为一个图卷积层,递归地更新图中所有节点的隐藏状态。”“每个节点的隐藏状态是根据其自身的特征和前一个时间步中相邻节点的隐藏状态更新的,两者都是用回声状态权值提取的。这个过程重复四次,然后将所有节点的隐藏状态求和为一个向量来表示整个图,使用读出层对其进行分类。这个过程重复四次,然后将所有节点的隐藏状态汇总成一个向量,作为整个图的表示,这是由读出层分类的。”

Wang和他的同事提出的软硬件设计有两个显著的优势。首先,它所基于的回波状态神经网络需要的训练要少得多。其次,该神经网络在不需要编程的随机和固定电阻存储器上有效地实现。

Wang说:“我们的研究最显著的成就是随机电阻存储器和回波状态图神经网络(ESGNN)的集成,它保留了内存计算的能量面积效率提升,同时还利用介电分解的内在随机性来提供ESGNN的低成本和纳米级硬件随机化。”“具体来说,我们提出了一种用于图形学习的硬件-软件协同优化方案。这样的协同设计可能会激发电阻存储器的其他下游计算应用。”

在软件方面,Wang和他的同事们介绍了一个由大量随机和循环互连的神经元组成的ESGNN。该神经网络采用迭代随机投影来嵌入节点和基于图的数据。这些投影在混沌边缘生成轨迹,使高效的特征提取成为可能,同时消除了与传统图神经网络发展相关的艰苦训练。

“在硬件方面,我们利用电阻开关中介电击穿的内在随机性来物理上实现ESGNN中的随机投影,”Wang说。“通过将所有电阻单元偏压到击穿电压的中位数,如果击穿电压低于应用电压,一些单元将经历介电击穿,形成随机电阻阵列,以表示ESGNN的输入和递归矩阵。与使用数字系统生成的伪随机数相比,这里的随机性的来源是由电阻存储单元的组成不均匀性引起的随机氧化还原反应和离子迁移,为内存计算提供了低成本和高度可扩展的随机电阻阵列。”

在最初的评估中,Wang和他的同事创建的系统取得了令人满意的结果,运行esgnn比数字和传统的电阻存储器解决方案更有效。在未来,它可以实现到各种现实世界的问题,需要分析数据,可以表示为图形。

Wang和他的同事们认为他们的软硬件系统可以应用于广泛的机器学习问题,因此他们现在计划继续探索其潜力。例如,他们希望评估其在序列分析任务中的性能,其中在记忆阵列上实现的回声状态网络可以消除编程的需要,同时确保低功耗和高精度。

王补充说:“这项工作中展示的原型是在相对较小的数据集上进行测试的,我们的目标是通过更复杂的任务来突破它的极限。”

免责声明:文章内容来自互联网,本站不对其真实性负责,也不承担任何法律责任,如有侵权等情况,请与本站联系删除。

转载请注明出处:一种集成回波状态图神经网络和模拟随机电阻存储器阵列的系统-回波信号的产生与消除 https://www.yhzz.com.cn/a/8954.html